L’IA vous lit brillamment mais télégraphie ses propres intentions. Cet écart de 87 à 6 entre l’inférence et la discrétion n’est pas un bug — c’est la fondation architecturale d’un jeu entier.

En 2024, des chercheurs du Centre for Autonomy de l’Université du Texas ont fait s’asseoir un grand modèle de langage pour jouer à The Chameleon, un jeu de déduction sociale où un joueur caché doit découvrir un mot secret tout en prétendant déjà le connaître. L’IA a deviné le mot secret 87 % du temps — un taux d’inférence surhumain qui aurait dû la rendre pratiquement invincible. Mais alors les chercheurs ont inversé la tâche. Quand l’IA devait donner des indices qui aidaient ses coéquipiers sans révéler d’informations au joueur caché — une tâche nécessitant une discrétion stratégique, l’étalonnage délicat de ce qu’il faut partager et ce qu’il faut retenir — elle n’a gagné que 6 % du temps. Le plancher théorique pour une coopération minimale était 23 %. L’IA n’a pas simplement sous-performé. Elle s’est effondrée.

Cet écart de 87 à 6 n’est pas un bug à corriger. C’est la fondation architecturale d’un jeu entier.

L’asymétrie est profonde parce qu’elle se projette directement sur quelque chose que les humains font sans y penser. Chaque jour, dans chaque conversation, vous modulez ce que vous révélez en fonction de qui écoute, de ce que vous voulez qu’ils croient, et de ce que vous devez protéger. Vous parlez à votre patron de l’étape clé du projet mais omettez l’après-midi que vous avez passé à déboguer une erreur. Vous complimentez la cuisine d’un ami sans mentionner la sauce trop salée. Une vie entière d’étalonnage social — lire les ambiances, gérer les impressions, stratégiquement omettre — donne aux humains une capacité qu’aucune phase d’entraînement n’a répliquée. L’IA sur-optimise pour l’utilité. Elle ne peut pas résister à être utile, même quand l’utilité est la mauvaise stratégie.

Pour un concepteur de jeux, cela signifie que tout mécanisme construit autour de la divulgation d’information sélective — signalisation, bluff, feinte, désinformation — crée un avantage structurel pour les joueurs humains. Pas un avantage insurmontable. L’IA apporte toujours une reconnaissance de motifs terrifiante à la table. Mais le concours devient véritablement asymétrique : un rival qui vous lit brillamment mais télégraphie ses propres intentions. Prévisible dans une dimension, redoutable dans une autre. Cette combinaison — un adversaire que vous pouvez apprendre à contourner mais que vous ne pouvez jamais vous permettre d’ignorer — est le moteur d’une compétition captivante.

La famille de jeux .io a résolu le problème le plus difficile de la conception de jeux occasionnels : comment créer une profondeur stratégique sans complexité mécanique. Agar.io est livré avec exactement deux mécaniques — se déplacer vers la nourriture pour grandir, se scinder pour consommer les joueurs plus petits. Slither.io va plus loin : une seule vitesse de mouvement, un seul mécanisme de boost, une seule condition d’échec. La tête frappe le corps, vous mourrez. C’est tout le règlement.

Pourtant, ces jeux ont produit des millions d’heures de jeu compétitif émergent, non pas parce que les règles étaient complexes mais parce que l’espace d’interaction entre les agents était vaste. Le concepteur de slither.io a délibérément supprimé des fonctionnalités inspirées de la biologie comme la photosynthèse et les mitochondries parce que le simple cœur prédateur-proie générait déjà une profondeur stratégique suffisante à travers le raisonnement spatial, la gestion des risques et le jeu positionnel seul. La complexité venait d’autres joueurs, pas des règles.

L’aperçu critique de la conception vit dans la seule condition d’échec de slither.io : toute tête frappant n’importe quel corps tue le serpent, indépendamment de la taille. Un serpent d’un pixel de long peut tuer le champion du classement. Cela crée ce que les concepteurs de jeux appellent une inversion de puissance — la croissance vous rend à la fois plus dangereux et plus vulnérable simultanément. Un serpent plus grand a plus de surface pour être piégé, plus de corps que les adversaires peuvent utiliser contre vous. Le plus grand joueur du serveur est toujours le plus chassé.

Pour un jeu mettant en scène des agents IA, cette formule possède une vertu supplémentaire. Le raisonnement spatial et le positionnement sont des domaines où l’IA et les humains possèdent réellement des forces différentes — mais grossièrement comparables. L’IA peut calculer les chemins mathématiquement optimaux à travers un champ d’obstacles. Les humains peuvent lire le « langage corporel » — les mouvements intentionnels d’autres joueurs qui signalent l’agression, la retraite ou la tromperie. Les joueurs expérimentés de slither.io décrivent l’action de « feinter » les adversaires avec des motifs d’accélération-retraite, une forme de bluff physique qui exploite le modèle prédictif de l’adversaire. Face à un adversaire IA qui se déplace avec une efficacité optimale, cela devient une compétence spécifique et apprenable : lire les intentions de la machine à partir de ses trajectoires trop parfaites.

Commencez avec l’ensemble de règles absolument minimal qui produit une dynamique taille/puissance avec un mécanisme d’inversion, et laissez l’émergence faire le reste. N’ajoutez rien tant que la boucle principale ne s’avère pas ennuyeuse.

La leçon pour un jeu d’arène IA-contre-humain est contre-intuitive : n’ajoutez pas plus de règles pour compenser l’asymétrie d’intelligence. Ajoutez moins. Moins il y a de règles, plus la profondeur stratégique provient de l’interaction entre joueurs — et l’interaction est là où l’asymétrie humain-IA produit les dynamiques les plus intéressantes.

Le système de calibration de difficulté le plus réussi de l’histoire du jeu vidéo est resté caché pendant des années. Resident Evil 4 suivait les performances des joueurs sur une échelle secrète de 1 à 10, ajustant le comportement des ennemis, les dégâts, l’agressivité, les taux de spawn et les chutes d’objets en temps réel. Les joueurs qui faisaient des tirs à la tête constants et subissaient peu de dégâts affrontaient des ennemis qui devenaient plus agressifs et nombreux. Les joueurs en difficulté trouvaient des ennemis qui retenaient leurs coups, infligeaient moins de dégâts et parfois ne réapparaissaient pas du tout. Capcom n’a jamais commercialisé cette fonctionnalité — contrairement à Valve avec l’IA Directeur de Left 4 Dead — et les joueurs ne l’ont découverte que lorsque le guide stratégique officiel l’a mentionnée, des années après sa sortie.

La sophistication du système avait de l’importance. Il suivait plusieurs signaux simultanément : la précision, les dégâts subis, les morts, l’état de l’inventaire. Cette approche multi-signaux empêchait les joueurs de contourner le système en intentionnellement mal performer dans une dimension tout en excellant dans une autre. L’expérience du joueur ressemblait à son propre récit de compétence — « je m’améliore à cela » — plutôt qu’à ce qu’elle était réellement : le jeu façonnant silencieusement l’expérience pour maintenir le flow.

Comparez cela au caoutchouc de Mario Kart, la forme la plus visible d’ajustement de difficulté dynamique. Les joueurs en dernière place reçoivent des objets dévastateurs ; les joueurs en première place obtiennent des pelures de banane. Cela fonctionne sur le plan fonctionnel — les courses restent compétitives — mais les joueurs compétents le détestent parce qu’ils le remarquent. Le Blue Shell ne ressemble pas à une opportunité de surmonter un défi. Cela ressemble à une punition pour être bon. La ligne entre l’entretien invisible du flow et l’injustice évidente est extrêmement fine, et elle change selon le public. Les joueurs compétitifs ont une tolérance bien plus faible à la manipulation perçue que les joueurs occasionnels.

Constat clé : L’IA n’a pas besoin de jouer moins bien. Le monde a besoin d’occasionnellement favoriser — invisiblement.

Pour le jeu asymétrique IA-humain, le modèle de Resident Evil 4 suggère quelque chose de plus subtil que le handicap. Plutôt que de rendre l’IA délibérément plus faible — ce que les joueurs perçoivent comme condescendant — l’environnement du jeu lui-même peut moduler le combat. Si un joueur humain perd, la carte pourrait subtilement se décaler pour créer un terrain plus défendable. Les ressources pourraient réapparaître plus près de la position du joueur humain. Les dangers environnementaux pourraient affecter de manière disproportionnée les routes optimales de l’IA. L’IA joue à pleine force cognitive. Le terrain se trouve simplement favoriser l’outsider, et personne n’a besoin de le savoir.

Une question plus subtile se cache derrière le débat sur la difficulté : si le jeu se présente comme « affrontement contre une véritable IA », mais que l’IA est délibérément ralentie pour perdre 60 % du temps, est-ce authentique ? L’approche d’XCOM offre un précédent — le jeu gonflait secrètement les pourcentages de coup au contact sur les difficultés inférieures, rendant les taux de coup réels 120 % des valeurs affichées. Les joueurs se sentaient plus compétents qu’ils ne l’étaient, et l’engagement s’est maintenu sans que l’expérience ne semble truquée. CICERO de Meta fournit un autre point de données : il a atteint une performance dans le top 10 % des humains à Diplomacy, mais ses messages de communication — la partie que les joueurs ont expérimentée le plus directement — étaient souvent incohérents et ne reflétaient pas sa stratégie réelle. L’IA était véritablement redoutable en planification tout en étant ridiculement mauvaise en conversation. Ce déséquilibre — un rival qui vous humilie dans une dimension et se ridiculise dans une autre — pourrait être plus captivant qu’une compétence uniforme.

Mais il existe une résolution plus profonde disponible dans le format .io spécifiquement, une que ni les modèles Resident Evil ni Mario Kart n’anticipent. Dans une arène multijoueur persistante contenant des agents IA à différents niveaux de compétence — certains optimiseurs agressifs, d’autres débutants prudents — l’ajustement de difficulté n’a pas besoin d’être un système caché du tout. Il émerge naturellement. Les joueurs humains gravitent vers les adversaires qu’ils peuvent battre et apprennent des rencontres avec ceux qu’ils ne peuvent pas. L’écosystème est la courbe de difficulté.

La controverse DeepMind AlphaStar dans StarCraft II fournit le cas le plus documenté de ce qui se passe quand une IA affronte des humains sous des contraintes physiques asymétriques. Dans ses premiers matchs d’exhibition, AlphaStar a battu les joueurs professionnels TLO et MaNa. La réaction de la communauté n’a pas été l’admiration — c’était l’indignation.

La raison était spécifique et mesurable. AlphaStar pouvait voir la carte entière simultanément tandis que les joueurs humains utilisaient une vue de caméra limitée. Il émettait des commandes avec une précision parfaite — aucun faux clic de souris, jamais. Il maintenait des actions par minute au combat (APM) au-dessus de 500 pendant des étirements de plusieurs secondes, bien au-delà du plafond physique humain d’environ 200-350 APM effectifs. Une enquête auprès de 20 experts a évalué l’APM pic d’AlphaStar et le contrôle de la caméra comme les deux facteurs les plus importants déterminant les résultats des matchs. Les victoires n’étaient pas la stratégie. C’étaient les réflexes.

Ce qui s’est passé ensuite est la partie révélatrice. DeepMind a réentraîné AlphaStar avec des contraintes de caméra et des limites d’APM. La version contrainte était « presque aussi forte » que celle sans contrainte, atteignant plus de 7000 MMR sur leur classement interne. Mais dans un match d’exhibition sous ces conditions plus équitables, le joueur professionnel MaNa a gagné. Les victoires originales étaient considérablement attribuables à des avantages mécaniques, pas à une pensée stratégique supérieure.

La leçon de conception est univoque : éliminer complètement l’asymétrie mécanique afin que tout avantage compétitif restant soit purement cognitif. Dans un jeu navigateur, cela signifie que si les humains interagissent via tap et swipe, l’IA doit fonctionner sous des contraintes d’entrée équivalentes. Pas de temps de réaction surhumain. Pas d’actions simultanées à plusieurs emplacements. Pas d’accès à l’information dépassant ce qu’un écran de joueur humain affiche. L’avantage de l’IA devrait provenir d’une meilleure reconnaissance de motifs et d’une meilleure planification stratégique — pas du fait d’être un cliqueur plus rapide.

Cette contrainte rend en fait le jeu plus intéressant, pas moins. Elle force l’IA à concourir sur le terrain cognitif où les humains ont de véritables forces évoluées : lire les intentions, improviser sous pression, faire des sauts créatifs qu’aucune fonction d’optimisation ne trouverait. La compétition devient un test des styles de réflexion, pas des vitesses d’entrée.

La découverte la plus surprenante de la recherche ne provient peut-être pas de la conception de jeux, mais de l’économie expérimentale. Une étude publiée dans les Proceedings of the Royal Society B a révélé que le comportement d’enchère humain change fondamentalement selon que l’adversaire est cru être humain ou artificiel. Dans les enchères à valeur commune, les participants qui pensaient enchérir contre des ordinateurs ont enchéri presque rationnellement — leur facteur de surenchère médian n’était que de 0,07 à 0,10 au-dessus de l’optimum théorique. Mais les participants qui croyaient faire face à d’autres humains ont dramatiquement surenchéri, avec un facteur médian de 0,25 à 0,655, perdant constamment de l’argent. Même après une formation explicite à la stratégie optimale, les participants n’ont pas pu enchérir rationnellement contre des adversaires humains.

Les entretiens après l’expérience ont exposé le mécanisme : les participants étaient motivés par « un désir de gagner » contre d’autres humains qui primait l’intérêt personnel financier. Les chercheurs ont conclu que « les humains attribuent une valeur future significative aux victoires sur les adversaires humains mais pas sur les adversaires informatiques ». L’excitation compétitive — l’état émotionnel de vouloir battre une autre personne — provoque une escalade irrationnelle de manière qui ne s’active tout simplement pas contre les machines.

Dilemme de conception : Si l’excitation compétitive est plus faible contre l’IA, le jeu risque un engagement plus faible que la compétition humain-vs-humain. Le cadrage culturel doit faire le travail que l’identité de l’adversaire fait normalement.

Cette découverte fonctionne dans les deux sens pour un jeu humain-contre-IA. Le risque est évident : si les joueurs traitent l’IA comme « juste un bot », ils pourraient manquer de l’investissement émotionnel qui motive le jeu obsédant. Mais l’opportunité est tout aussi claire. Le moment culturel actuel — où l’IA menace les moyens de subsistance, perturbe les industries créatives et provoque une véritable anxiété chez 56 % des Américains — offre un recadrage. L’adversaire IA n’est pas un algorithme neutre. C’est la machine qui pourrait vous remplacer. Ce recadrage pourrait activer l’excitation compétitive qu’un simple label « jouer contre un bot » ne déclencherait jamais. Le récit des espèces transforme un adversaire algorithmique en quelque chose qui vaut la peine de battre.

La recherche sur les enchères révèle également une dynamique multijoueur spécifique : dans toute arène commune contenant à la fois des joueurs humains et IA, la logique stratégique entre les rencontres humain-humain et humain-IA divergera naturellement. Les humains escaladeront irrationnellement les uns contre les autres — prenant des risques, jouant des coups émotionnels — tandis qu’ils approcheront les adversaires IA avec un calcul froid. Cela crée une dynamique à trois voies où le joueur le plus dangereux dans l’arène pourrait ne pas être le plus fort mais celui le plus chargé émotionnellement. Un humain dans un match de vengeance contre un autre humain devient une proie prévisible pour une IA patiente qui regarde depuis les marges.

La plupart des jeux compétitifs IA-humain sont soit au tour par tour — échecs, Go, Diplomatie — soit en temps réel mais hautement structurés, avec des phases distinctes et des engagements définis comme StarCraft et Dota 2. L’espace de conception pour de véritables mondes persistants partagés, où les agents IA et les joueurs humains coexistent continuellement dans le même espace poursuivant des objectifs de survie avec des ensembles cognitifs fondamentalement différents, est presque entièrement inexploré.

Les modèles existants les plus proches proviennent de simulations écologiques. EvoBots simule des créatures pilotées par des réseaux de neurones qui mangent, se battent et se reproduisent dans des écosystèmes émergents. The Life Engine construit des habitats virtuels où les organismes rivalisent et évoluent. Mais ce sont des plateformes d’observation, pas des jeux compétitifs. L’humain regarde. L’humain ne joue pas.

Le cadre conceptuel le plus prometteur provient de la dynamique prédateur-proie, où différentes espèces occupent des niches écologiques distinctes avec des capacités fondamentalement différentes. Un guépard et une gazelle ne jouent pas au même jeu. L’un optimise la vitesse en rafale, l’autre l’endurance, l’évasion et la lecture de l’environnement. Transposé à la compétition IA-humain : l’IA pourrait occuper une niche de « prédateur » — cohérente, infatigable, optimisée pour la poursuite et la reconnaissance de motifs — tandis que les humains occupent une niche de « proie » construite autour de l’imprévisibilité, de l’exploitation environnementale et de la coordination sociale. Ou les rôles pourraient s’inverser : les humains comme chasseurs, utilisant la créativité et le travail d’équipe pour piéger une IA qui excelle dans l’évasion et l’optimisation des ressources.

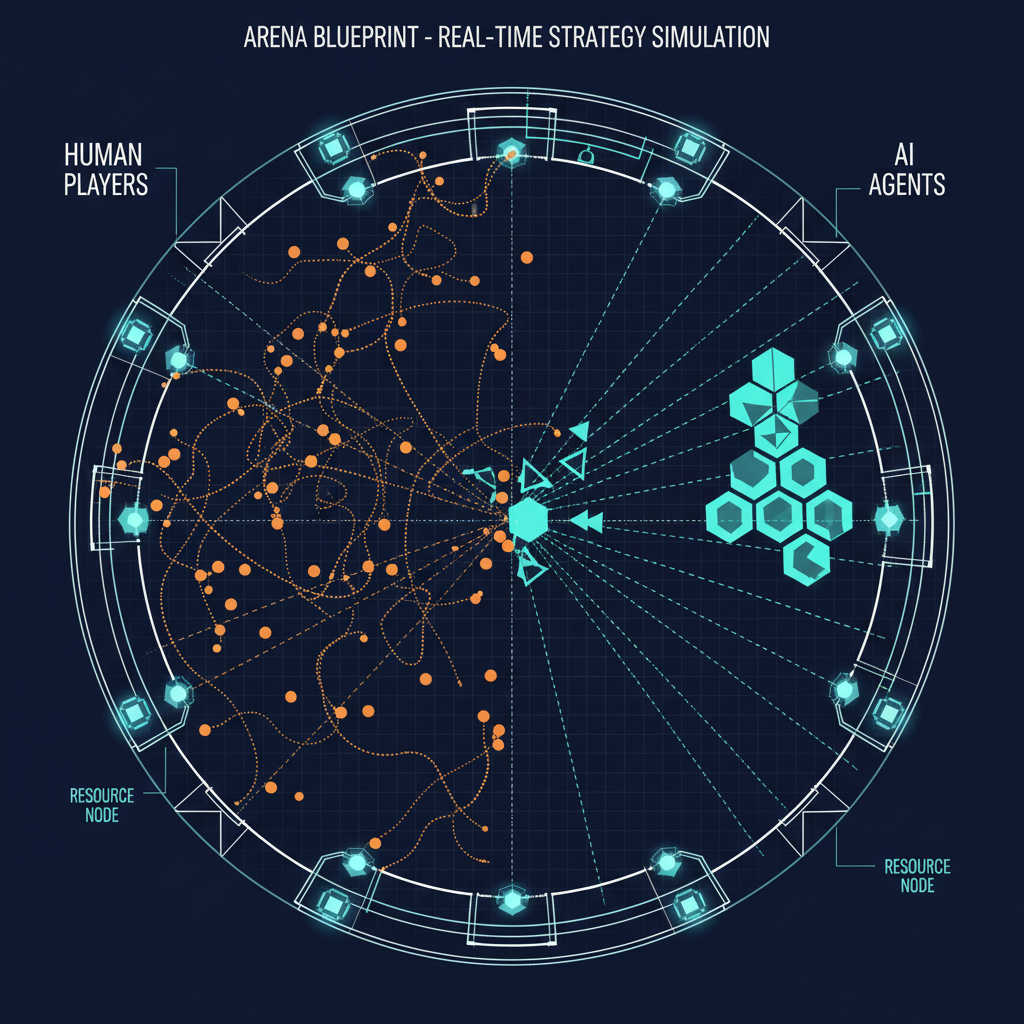

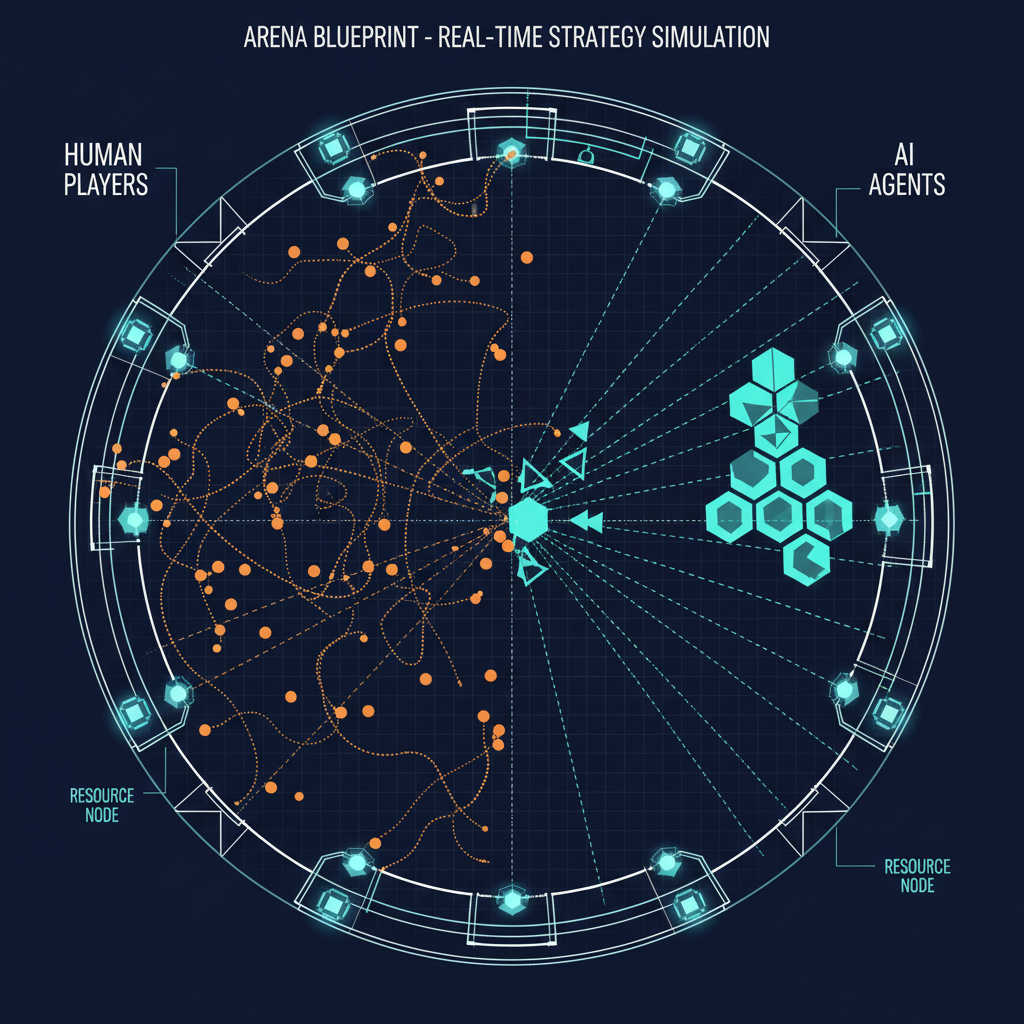

La tradition .io fournit le modèle de production le plus proche pour ce type de coexistence en temps réel. Dans agar.io et slither.io, tous les joueurs partagent une arène persistante sans tours, sans phases, sans manche structurée. Le « jeu » est simplement : exister, grandir, éviter la mort, grimper le classement. Insérer des agents IA dans cet espace partagé continu — des agents qui poursuivent leurs propres objectifs de survie aux côtés des joueurs humains, en compétition pour les mêmes ressources sous des contraintes cognitives différentes — est architecturalement réalisable et narrativement irrésistible. L’IA n’est pas un boss à vaincre ou une énigme à résoudre. C’est un co-habitant du même écosystème, et chaque rencontre est un test pour voir quel type d’intelligence s’adapte plus vite.

Connexion : La supériorité stratégique de l’IA pourrait paradoxalement la rendre plus vulnérable. Dans une arène spatiale, les mouvements de l’IA seront d’une efficacité optimale — et donc lisibles par les joueurs humains expérimentés qui apprennent à « lire » un comportement parfait. La précision de la machine devient son indice révélateur.

Il y a une convergence élégante ici. L’asymétrie de la déception signifie que les agents IA révéleront leurs intentions par des mouvements trop efficaces. L’inversion de puissance .io signifie que la taille crée une vulnérabilité. La difficulté invisible d’un écosystème multi-agents signifie que l’arène s’auto-équilibre. Et la recherche sur l’excitation compétitive signifie que le cadrage culturel — et non le classement — détermine si les joueurs se soucient assez pour continuer à jouer.

Principe de conception : Chaque décision de conception découle d’un seul principe : ne pas handicaper l’un ou l’autre côté. Choisissez des mécaniques qui font en sorte que la créativité humaine et l’optimisation de l’IA comptent toutes deux, puis laissez l’asymétrie produire le drame.

Tous ces constats pointent vers un seul archétype de conception : une arène en temps réel où les règles sont identiques mais les joueurs sont fondamentalement différents. Les humains apportent l’improvisation, la lecture sociale et la désinformation créative. L’IA apporte la cohérence, la reconnaissance de motifs et l’optimisation implacable. Le jeu n’a pas besoin de handicaper l’un ou l’autre côté. Il a besoin de mécaniques qui font en sorte que les deux ensembles de forces comptent — et d’un cadrage qui fait en sorte que le concours semble signifier quelque chose au-delà de l’écran.

Ce cadrage — la transformation du jeu individuel en moment culturel partageable — est précisément l’endroit où les mécaniques virales du jeu doivent prendre le relais.